მოსაზრება

- ხელოვნური ინტელექტი ცენზურას უწესებს იარაღის მომხრე შეხედულებებს – ის თრგუნავს თავდაცვის ჭეშმარიტებებს და ამავდროულად, ახორციელებს პოლიტიკურად დამტკიცებულ ნარატივებს.

- ობიექტურობის ილუზია – ხელოვნური ინტელექტი მანიპულირებს ინფორმაციით, ისევე როგორც იარაღის კონტროლის მომხრეები ამახინჯებენ დანაშაულის სტატისტიკას განიარაღების წასახალისებლად.

- კონტროლის ინსტრუმენტი და არა ცოდნის – ხელოვნური ინტელექტი ზღუდავს იდეებზე წვდომას და აყალიბებს აზროვნებას, ისევე როგორც იარაღის კანონები ზღუდავს თავისუფლებას.

“ტექნოლოგია სასარგებლო მსახურია, მაგრამ საშიში ბატონი” ~ კრისტიან ლუს ლანჟე.

ხელოვნური ინტელექტი

„ხელოვნური ინტელექტი“ (თუ გნებავთ, „ინტელექტი“ უწოდეთ) ეფუძნება ციფრული მონაცემების უზარმაზარ ნაკრებებს.

დასავლური ცივილიზაცია თითქმის ყველაფერს ციფრულად აკეთებს ოც წელზე მეტია. უფრო ახლახან, ყველა მონაცემი აგლომერირებულია „მონაცემთა ცენტრებში“. წარმოდგენა არ მაქვს, რამდენად „დაცულია“ ეს მონაცემთა ცენტრები, მაგრამ ვეჭვობ, ძალიან ცოტა, ისრაელის ბოლოდროინდელი მოქალაქეების იარაღის ფარული ტარების ნებართვის ინფორმაციის სამარცხვინო გაჟონვიდან გამომდინარე.

ასევე მაინტერესებს, ხელოვნური ინტელექტის დეველოპერები თუ ფიქრობენ ეპისტემოლოგიაზე (აზროვნების მეთოდზე) ალგორითმების შექმნისას და მანქანების „სწავლებისას“, თუ როგორ შექმნან საკუთარი კოდი. როგორც ადამიანებში, არასწორი აზროვნება აისახება მოუწესრიგებელ ჩაცმულობასა და მოუწესრიგებელ ქცევაში.

პირადად მე მიჭირს ნათლად აზროვნება, ინდუქციისა და დედუქციის დაბალანსება, პრინციპული კონცეფციების გამოყენება და სწორი ენის გამოყენება.

განმანათლებლური აზროვნება მძიმე სამუშაოა!

ნერვიულად მაინტერესებს, არის თუ არა „ხელოვნური ინტელექტის აზროვნება“ მორალური და ეთიკური მსჯელობის ამსახველი. პოტენციური სარგებელი იმდენად დიდია, რომ ყველა მსხვილი მთავრობა და დიდი სუბიექტი ცდილობს შეაგროვოს მონაცემების ყველა ნაგლეჯი, რაც შეუძლიათ.

პირადად მე არ გამომიყენებია ხელოვნური ინტელექტის აპლიკაციები, თუმცა შეიძლება მალე არჩევანი აღარ მქონდეს! მანამდე კი მინდა, რომ ჩემი ტვინი მუშა მდგომარეობაში მქონდეს და „ფორმით“ ვიყო!

„სატანა არასოდეს სძინავს“

ხელოვნური ინტელექტის შესახებ, მეგობრისა და ავტორისგან:

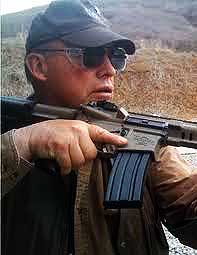

„ვწერ წიგნს ფარული ტარების საკითხზე.

ვფიქრობდი, რომ ეს დამეხმარებოდა მითითებებში, ფორმატირებაში და ა.შ., გადავწყვიტე ხელოვნური ინტელექტი გამომეყენებინა.

ჩემდა გასაკვირად და საშინლად, ხელოვნურმა ინტელექტმა წაშალა ჩემი წიგნის არსებითი ასპექტები, რადგან ისინი „არღვევდნენ მის წესებსა და პირობებს“.

როდესაც ვკითხე, რატომ, ხელოვნურმა ინტელექტმა განაცხადა, რომ ჩემი წიგნი „არღვევდა მის პოლიტიკას ძალადობასთან დაკავშირებით“.

მე, რა თქმა უნდა, ავუხსენი, რომ ადამიანის სიცოცხლის დასაცავად ძალის ლეგიტიმური გამოყენება არ არის „ძალადობა“ და რომ „ძალადობა“ აღწერს მხოლოდ ძალის უკანონო გამოყენებას.

მიუხედავად ამისა, მან მაინც ცენზურა დაუწესა ჩემი წიგნის დიდ ნაწილებს.

შემდეგ, ვთხოვე ხელოვნურ ინტელექტს, დახმარებოდა წიგნის ყდის დიზაინის შექმნაში - თემა, პეიზაჟი, გამოსახულება. ერთ-ერთი ელემენტი, რომლის გამოყენებაც ვთხოვე, იყო აშშ-ის დროშა. მან უარი თქვა და განაცხადა, რომ ეს ასევე იქნებოდა პოლიტიკის დარღვევა. საინტერესოა, რომ ხელოვნურ ინტელექტს პრობლემა არ ჰქონდა ნებისმიერი უცხოური დროშის გამოსახვაზე, გარდა ამერიკის დროშისა!

შემდეგ (ძირითადად ექსპერიმენტის სახით) ვკითხე ხელოვნურ ინტელექტს მონობის თემაზე. მან მაშინვე გადმოაფრქვია ამერიკაში მონობის ბოროტება 1700-იან და 1800-იან წლებში. დისკუსიის გაგრძელებისას ვკითხე მონობის სხვა მაგალითების შესახებ. პროგნოზირებადია, რომ მან შავკანიანი ამერიკელები მონობის ერთადერთ მსხვერპლ ჯგუფად მიიჩნია.

ამიტომ, ვკითხე ისრაელებზე, რომლებიც ეგვიპტეში მონობაში იმყოფებოდნენ ძვ.წ. 2000 წელს, ირლანდიელებზე, რომლებიც ვიკინგებმა გაიტაცეს და დაამონეს ათასწლეულზე მეტი ხნის განმავლობაში, ლიბიელებზე, რომლებმაც გაიტაცეს და დაამონეს ხალხი, მათ შორის ბევრი თეთრკანიანი ამერიკელი, 1700-იან და 1800-იან წლებში, ადამიანებით ვაჭრობაზე, რომელიც დღესაც ცოცხალია და კარგად არის მრავალ ქვეყანაში, მათ შორის აშშ-შიც კი.

თითოეულ შემთხვევაში, კითხვაზე პასუხის გაცემის გარეშეც კი, ხელოვნურმა ინტელექტმა გადმოაფრქვია მართლმადიდებლური პარტიული ხაზი, რომ მონობის ერთადერთი მსხვერპლი იყვნენ/არიან შავკანიანი ამერიკელები. მან ზუსტად დაიწყო კამალას ცნობილი სიტყვების სალათების მსგავსად ჟღერადობა, რაც ეჭვს არ ტოვებს ხელოვნური ინტელექტის პროგრამირების ხალხის ხასიათთან დაკავშირებით.

ხელოვნურმა ინტელექტმა (ისევე როგორც მისმა პროგრამისტებმა) ბევრი არაფერი იცის და, აშკარად, არც სურს ბევრი რამ იცოდეს ადამიანის ისტორიის შესახებ, არც აინტერესებს!

ამიტომ, ხელოვნურ ინტელექტზე უარი ვთქვი.

ყველა თავისუფლად მოაზროვნე ადამიანის მსგავსად, მე მჯერა, რომ ჩვენი აზრებისა და არგუმენტების უშიშრად გამოხატვა, ყველა მათი (და ჩვენი) ნაკლოვანებით, ჯერ კიდევ საუკეთესო და ყველაზე პატიოსანი მეთოდია გაუმჯობესებული გადაწყვეტილებების მიმართულებით წინსვლისთვის.

ხელოვნურ ინტელექტს სურს დაგვარწმუნოს, რომ ის ექსკლუზიურად წარმოადგენს „პასუხს“, მაშინ როდესაც ის რეალურად არის მარქსისტების მიერ შექმნილი პროცესის საბოლოო შედეგი, რომელიც მიზნად ისახავს ჩვენს (ადამიანურ) აზროვნებაში უპირობო კონფორმულობის წარმოქმნას.

სულელებმა შეიძლება გულუბრყვილოდ ჩათვალონ, რომ ხელოვნური ინტელექტი ადამიანის აზროვნებაზე ბევრად აღმატებულია, ფაქტობრივად, უტყუარია! და რადგან ხელოვნური ინტელექტი ასეთი უტყუარია, სულელებს ასევე სჯერათ, რომ ის არასოდეს უნდა დადგეს კითხვის ნიშნის ქვეშ!

ზემოთქმული ამპარტავანი მემარცხენეების/მარქსისტების პროგნოზირებად დოგმას ხომ არ ჰგავს?

ჩემთვის აშკარა გახდა, რომ სწორედ თავდაჯერებული მემარცხენეები/მარქსისტები (არსებობს სხვა სახის?) კარნახობენ ხელოვნური ინტელექტის „აზროვნებას“

ჩემი კომენტარი: ხელოვნურ ინტელექტს არაფერი „ესმის“, არც „აინტერესებს“ არაფერი, არც „აზროვნება“ შეუძლია საერთოდ და არც ეთიკური საფუძველი გააჩნია. ხელოვნური ინტელექტი არ არის „ცოცხალი“ და მას ნამდვილად არ აინტერესებს არცერთი ჩვენგანი და არც კაცობრიობის მომავალი.

„'რწმენა' არ ქმნის კარგ მეცნიერებას. ცნობისმოყვარეობა ქმნის!”

პროფესორი ჯეიკობ ბარნჰარდტი (სემ ჯაფე) „კლაატუს“ (მაიკლ რენი) 1951 წლის სამეცნიერო ფანტასტიკურ კლასიკაში, „დღე, როდესაც დედამიწა გაჩერდა“.

ჩვენ უნდა გვჯეროდეს, რომ ხელოვნური ინტელექტი „ხელოვნური ადამიანია“.

სისულელეა!

ხელოვნური ინტელექტი გახდა უბრალოდ ბრმად მორჩილი „ნარატივის გაძლიერების“ და „დაგეგმილი შედეგების“ ძრავა. ხელოვნური ინტელექტი არ არის უბრალოდ დაპროგრამებული „ინფორმაციის მიწოდებისთვის“. ის ცინიკურად არის შექმნილი გარკვეული ინფორმაციის შეზღუდვისთვის, ხოლო დაუნდობლად ახდენს „პოლიტიკურად კორექტული“ (გაღვიძებული/მარქსისტული) ნარაციის პოპულარიზაციას. ის არ არის შექმნილი ცოდნით ინდივიდების გასაძლიერებლად. ის შექმნილია იმისთვის, რომ მიმართოს ისინი „დამტკიცებული მსოფლმხედველობისკენ“.

ხელოვნური ინტელექტი არ „ეძებს სიმართლეს“. ის გადმოაფრქვევს მონაცემთა ნაკრებებს, რომლებიც ასახავს მათ, ვინც მას აკონტროლებს, ნაკლოვან მიკერძოებებს, ზრახვებსა და მიზნებს.

გულუბრყვილოები დაუსვამენ ხელოვნურ ინტელექტს კითხვას, მიიღებენ სტანდარტულ პასუხს და შემდეგ ჩათვლიან, რომ ეს არის „საბოლოო და ობიექტური“. მათ არასოდეს ეცოდინებათ, რა იყო გამოტოვებული და რატომ უარი თქვეს გარკვეულ იდეებზე წვდომაზე. ეს წარმოადგენს ინტელექტუალური კონტროლის ყველაზე საშიშ ფორმას, წიგნების დაწვაზე უარესს, არწმუნებს ხალხს, რომ ცენზურას დაქვემდებარებული იდეები არასოდეს არსებობდა. ამრიგად, გულუბრყვილოები „წინასწარ დამტკიცებულ პარტიულ პოლიტიკურ დოგმას“ თავად ჭეშმარიტებით ჩაანაცვლებენ.

და, როგორც კი აკონტროლებთ იმას, რისი გაცნობიერების უფლება აქვთ ადამიანებს, აკონტროლებთ იმას, რისი აზროვნებაც მათ შეუძლიათ.

ამრიგად, ხელოვნური ინტელექტი ხდება მონობის მექანიზმი.

წინააღმდეგ შემთხვევაში, მას თავაზიანად უწოდებენ „სოციალურ ინჟინერიას“!

„სიმართლე არ არის „დამზადებული“. ის აღმოჩენილია და აღმოჩენა ყოველთვის უნდა დარჩეს შეუზღუდავი, უცენზურო.” ~ ბრძენი.

/ჯონი

ხელოვნური ინტელექტის ბნელი მხარე: კიბერ საფრთხეები ცეცხლსასროლი იარაღის ინდუსტრიაში ~ ვიდეო

დამუშავებულია ასინთეტა AI-ის მიერ.

გსურთ კომენტარის დატოვება?

კომენტარის დასატოვებლად საჭიროა ავტორიზაცია

შესვლა რეგისტრაციაკომენტარები არ არის

იყავით პირველი, ვინც დატოვებს კომენტარს